그림 인공 지능 안정적인 확산오픈 소스이기 때문에 다양한 방법으로 사용할 수 있습니다. 나무위키 홈페이지보면 안정적인 확산 웹 UI, 텍스트 투 아트 디스코드 등의 여러 프로젝트가 있습니다. NovelAIStable Diffusion을 기반으로 구축된 웹 사이트도 있습니다.

나 먼저 안정적인 확산 웹 UI나는 설치를 시도했다. 그런 다음 클라우드를 통한 안정적인 확산을 사용하여 구글 코랩 저도 킁킁대고 왔습니다. 내가 사용하고 있는 PC가 이미 몇 년 된(찾아보니 2019년 9월) 고사양이 아니기 때문에 로컬에서 실행하기 어려울 것이라고 생각했기 때문이다. 그런데 바로 설치가 되지 않고 여러곳을 기웃거리다가 너무 꼬여서 어디가 잘못된건지 모르겠어서 파이썬을 여러번 삭제하고 설치했지만 결국 설치에 실패했습니다.

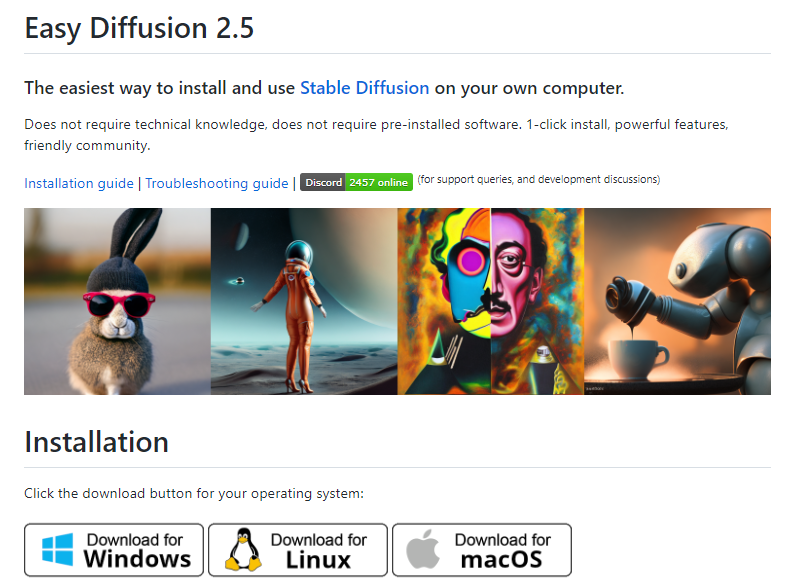

그런 다음 쉬운 확산설립하다 원래 안정적인 확산몇 가지 편리한 사용자 인터페이스를 갖춘 보안으로 볼 수 있습니다. 아래에서 설명하는 바와 같이 클릭 한 번으로 설치가 가능하기 때문에 기술적인 지식이나 다른 소프트웨어를 먼저 설치할 필요가 없습니다. 내 그래픽 카드 지포스 GTX1050 Ti인데, 간헐적으로 가동할 수 있다는 정보도 도움이 된다.

설치가 쉽습니다. 우측 상단에 보이는 “Download for Windows” 버튼을 클릭하면 “Easy-Diffusion-Windows.exe”라는 파일을 다운로드 받아 실행합니다.

달리기는 당연히 가능하다. 설치된 디렉토리(C:\EasyDiffusion 등)를 입력하면 다음 파일이 설치됩니다. 아래의 Start Stable Diffusio U.cmd를 두 번 클릭하십시오.

그러면 윈도우 콘솔이 뜨고 무언가를 실행(및 설치)하면 웹 탐색기에 다음과 같은 화면이 나타납니다. 이제 안정적인 확산을 사용할 수 있습니다. 이렇게 간단합니다.다음은 최초 실행시 (Make Image) 버튼을 간단히 눌러본 결과입니다.

이제 프롬프트 창에 일치하는 단어를 입력하면 해당 프롬프트에 일치하는 인공 지능 생성 이미지를 볼 수 있습니다. 며칠전에 설치해서 여러번 실행했는데 그래픽카드가 꼬여서 생성속도가 느리고 큰 이미지 생성시 오류가 생기고 가끔 완전 이상하게 보이는 이미지가 생성되는데 더 잘나왔습니다 생각보다 잘 사용하고 있습니다. ㅋㅋㅋ

===

다음은 이 사이트에서 Easy Diffusion의 이점을 요약한 것입니다. 그것을 참조하십시오.

기능

사용자 경험

- 간편한 설치: 기술 지식이 필요하지 않으며 사전 설치된 소프트웨어가 필요하지 않습니다. 그냥 다운로드하고 실행하십시오!

- 깨끗한 UI: 여전히 강력한 기능을 제공하면서 친근하고 간단한 인터페이스를 제공합니다.

- 작업 대기열: 작업이 완료될 때까지 기다리지 않고 현재 작업을 대기열에 추가할 수 있습니다.

- 지능형 모델 감지: 모델 데이터베이스를 통해 선택한 모델에 사용할 YAML 구성 파일을 자동으로 찾습니다.

- 실시간 미리보기 : AI가 그린 이미지를 실시간으로 확인할 수 있습니다.

- 이미지 수정자: 사실적, 연필 스케치, artstation 등과 같은 수정자 태그 라이브러리가 있습니다. 다양한 스타일을 빠르게 실험해 보세요.

- 여러 프롬프트 파일: 텍스트 파일을 실행하여 여러 프롬프트를 대기열에 추가할 수 있습니다.

- 생성된 이미지를 디스크에 저장: 생성된 이미지를 자동으로 저장할 수 있습니다.

- UI 테마: 원하는 대로 테마를 변경할 수 있습니다.

- 검색 가능한 모델 드롭다운: 모델을 하위 폴더로 구성하고 UI에서 검색할 수 있도록 합니다.

이미지 생성

- 지원: Text2Img 및 Img2Img가 지원됩니다.

- 19개 샘플러: ddim, plms, heun, euler, euler_a, dpm2, dpm2_a, lms, dpm_solver_stability, dpmpp_2s_a, dpmpp_2m, dpmpp_sde, dpm_fast, dpm_adaptive, unipc_snr, unipc_tu, unipc_tq, unipc_snr_2 등

- 인페인팅: 업데이트할 이미지 영역을 지정할 수 있습니다.

- 간단한 그리기 도구: 외부 그리기 프로그램 없이도 간단한 이미지를 그릴 수 있습니다.

- 얼굴 보정(GFPGAN)

- 업스케일링(RealESRGAN)

- 루프백: 출력 이미지를 다음 img2img 작업의 입력 이미지로 사용합니다.

- 부정적인 프롬프트: 생성할 이미지에서 제거할 속성을 지정합니다.

- 주의/강조: 속성을 강조하려면 명령 프롬프트에서 ()를 사용하고 속성을 낮추려면 ()를 사용하십시오.

- 가중치 프롬프트: 프롬프트에서 특정 단어에 가중치를 적용하여 중요성을 변경합니다(예: red:2,4 dragon:1,2).

- 프롬프트 매트릭스: 말을 탄 우주비행사의 사진 | 그림 | 영화 조명과 마찬가지로 다양한 프롬프트 변형을 쉽게 만들 수 있습니다.

- 1-클릭 업스케일/얼굴 미화: 생성 후 이미지를 확대하거나 향상시킵니다.

- 유사한 이미지 생성: 생성된 이미지의 여러 변형을 생성할 수 있습니다.

- NSFW 설정: NSFW(Backward Attention) 콘텐츠 생성 여부를 제어할 수 있습니다.

- JPEG/PNG/WEBP 출력: 여러 파일 형식을 지원합니다.

고급 기능

- 사용자 지정 모델: models/stable-diffusion 폴더에 .ckpt 또는 .safetensors 파일을 배치하여 다른 모델을 적용할 수 있습니다.

- 안정적인 확산 2.1 지원

- 모델 병합: 여러 모델을 병합하여 사용할 수 있습니다.

- 맞춤형 UAE 모델 사용

- 사전 훈련된 하이퍼네트워크 사용

- 커스텀 GFPGAN 모델 사용

- UI 플러그인: 커뮤니티에서 만든 UI 플러그인 목록에서 선택하거나 자신만의 플러그인을 작성할 수 있습니다.

성능과 안전

- 빠름: NVIDIA 3060 12GB에서 5초 만에 512×512 이미지(euler_a).

- 낮은 메모리 사용량: 3GB 미만의 GPU RAM으로 512 x 512 이미지를 생성하고 4GB 미만의 GPU RAM으로 768 x 768 이미지를 생성할 수 있습니다.

- CPU Enabled: 호환되는 그래픽 카드가 없어도 실행됩니다.

- 다중 GPU 지원: 사용 가능한 경우 더 빠른 성능을 위해 작업이 여러 GPU에 자동으로 분산됩니다!

- 자동 악성 모델 검색: picklescan을 사용하여 악성 모델을 방지합니다.

- Safetensor 지원: Safetensor 형식으로 모델 로드를 지원하여 보안을 강화합니다.

- 자동 업데이터: 최신 개선 사항 및 버그 수정을 자동으로 반영합니다.

- 개발자 콘솔: 안정적인 확산 코드를 변경하고 conda 환경을 편집하려는 개발자를 위한 지원 모드입니다.

====

좋은 글들이 많이 써져 있네요… 모르는게 많아서 공부하면서 업데이트 할게요~

분, 푸른 하늘